Artificial Neural Network

C++Machine LearningAlgorithmen

Warum

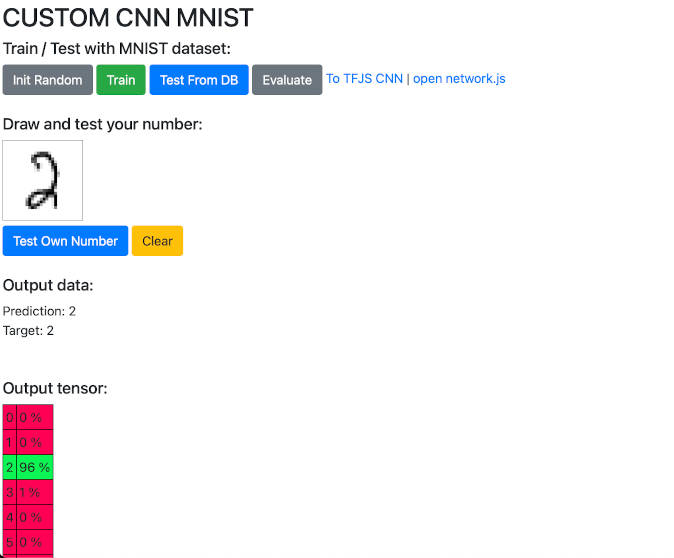

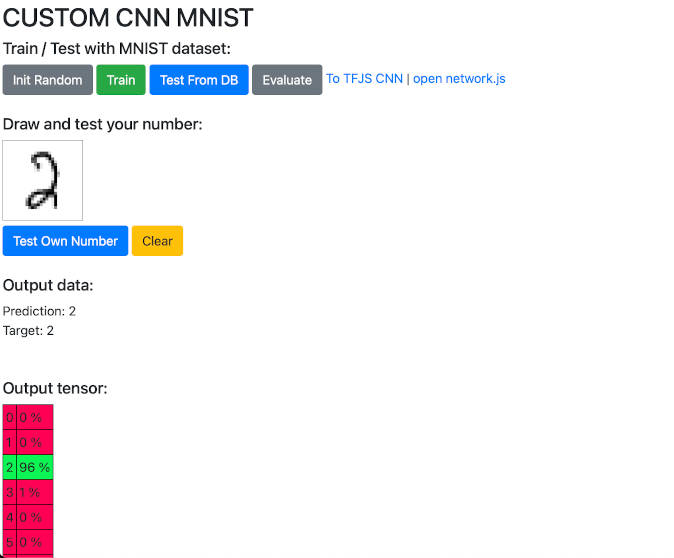

Ich wollte verstehen, was hinter Frameworks wie TensorFlow wirklich passiert. Backpropagation, Gradienten, Gewichts-Updates – das lässt sich lesen, aber man versteht es erst, wenn man jeden Schritt selbst schreibt und sieht, wie sich die Fehlerrate über Epochen verändert.

Was ich gelernt habe

Dass die Mathematik hinter neuronalen Netzen weniger mystisch ist als sie klingt – im Kern ist es Kettenregel und Matrixmultiplikation. Und dass die Wahl der Lernrate einen riesigen Unterschied macht: Zu groß, und das Netz divergiert; zu klein, und es lernt ewig.